Mas quando a poeira liquidou, muitos usuários sentiram que receberam um grampeador de escritório bege. Claro, funciona, mas não é emocionante, e definitivamente não parece uma atualização da vibração carismática do GPT-4O. Foi o futuro que nos foram prometidos? Ou apenas … burocracia com uma rede neural? 🤖📄

Oi galera, prontos para mergulhar no mundo louco das notícias de cripto? Junte-se ao nosso canal do Telegram onde deciframos os mistérios da blockchain e rimos das mudanças de humor imprevisíveis do Bitcoin. É como uma novela, mas com mais drama descentralizado! Não fique de fora, venha com a gente agora e vamos aproveitar a montanha-russa das criptos juntos! 💰🎢

☞ Junte-se ao Telegram

O dia em que a mágica morreu ✨⚰️

“If you hate nuance, personality, or joy-this is your model.”

Verdadeiramente, um elogio para a era digital. 🖋️💔

Os acessórios emocionais são reais ❤️🔗

Não se trata apenas de bugs ou velocidade. O verdadeiro barril de pó aqui é um apego emocional. O GPT-4O, para muitos usuários, não era apenas uma ferramenta-era uma personalidade. Um co-piloto. Um companheiro espirituoso, ocasionalmente sicófantico, que fazia você se sentir inteligente e interessante. Foi a vida da festa. Ou pelo menos a vida das guias do seu navegador.

GPT-5? É educado. Profissional. Business. E enquanto alguns especialistas são isso como lisonja sem progresso, menos manipulação emocional-também é mais fria. Pattie Maes, do MIT, apontou que as pessoas tendem a gostar da IA que refletem suas opiniões de volta para elas, mesmo que esteja errado. O GPT-5 parece projetado para resistir a essa tentação, e uma grande parte da base de usuários não perde claramente a reação digital do ego. Quem sabia que o narcisismo poderia ser tão cativante? 🫠💼

🔥 IMPERDÍVEL: Dólar pode DISPARAR contra o Real! Saiba antes que seja tarde!

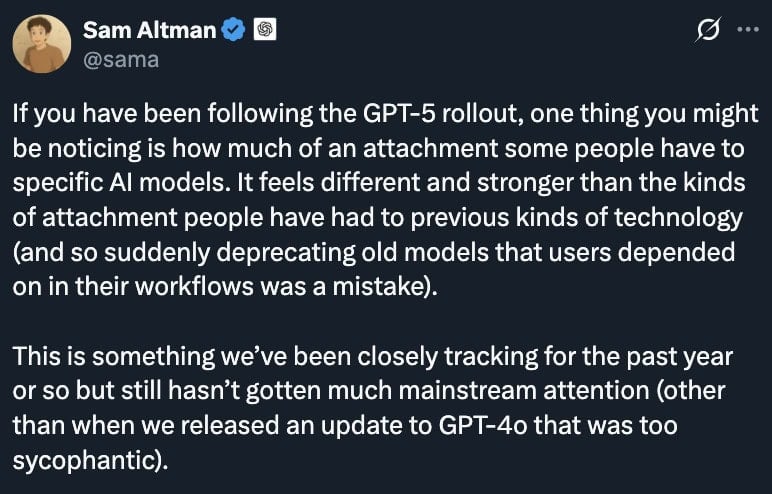

Ver previsão agora!Altman pisca 👀🚨

Na sexta -feira, o CEO da OpenAI, Sam Altman, estava no modo de controle de danos. Em um post em X, ele reconheceu o fracasso de roteamento, admitiu o GPT-5 “parecia muito mais burro” do que o pretendido e prometeu uma correção. Mais importante, ele anunciou que o GPT-4O retornaria para os assinantes Plus. A mensagem entre as linhas ficou clara: Ouvimos você. Por favor, não cancele. Tradução: “Lamentamos que tenhamos tentado substituir sua IA amada por algo que parece um auditor de impostos”. 📉💸

Altman também lançou um conjunto de mudanças destinadas a temperaturas de resfriamento:

- Dobrar os limites da taxa GPT-5 pelo pagamento de usuários. Porque nada diz “Nós nos importamos” como deixar você falar com nossa IA duas vezes mais.

- Controle melhor sobre o “modo de pensar”, para que os usuários possam decidir quando desejam o raciocínio lento e pesado ligado. Ou, como eu gosto de chamá -lo, “o equivalente da IA de pedir a alguém que pense antes de falar”. 🧠⏰

- Melhorias de roteamento em andamento para evitar repetir os desastres de gravação de desempenho. Dedos cruzados desta vez, pessoal. 🤞🛠️

O GPT-5 é uma conquista técnica impressionante, mas a máquina de hype emoldurou como a

next moon landing

. Essa é uma configuração perigosa quando o que você realmente entrega é um conjunto de ganhos de desempenho incremental, além de algumas opções de design que alteram fundamentalmente a “sensação” do produto.

Quando o GPT-4 foi lançado em março de 2023, ele surpreendeu todos os novos recursos, uma conversa mais rica, menos erros óbvios. Parecia o futuro que chegava da noite para o dia. O GPT-5, em comparação, parece um upgrade de ponto de software. É melhor de maneiras mais difíceis de notar e, de certa forma, as pessoas realmente fazem . Como atualizar o telefone apenas para encontrar a câmera estar um pouco mais embaçada. 📱📷

Esse é o segredo aberto na IA agora: à medida que esses sistemas amadurecem, os saltos se transformam em cutucadas. E cutucadas não são manchetes, a menos que venham com fogos de artifício-ou uma revolta completa do usuário. 🎆🔥

Por que isso importa 🤔📜

Este episódio é mais do que apenas um momento de “Reddit Is Mad”. É um lembrete de que o desenvolvimento da IA não é apenas uma corrida armamentista técnica-é um relacionamento. As pessoas formam hábitos, dependências e até afeto por esses sistemas. Troque a personalidade e você não corre o risco de decepcioná-los-você corre o risco de quebrar a confiança.

O OpenAI está agora tentando caminhar uma linha tênue: avançar em direção a IA mais responsável e menos manipuladora, sem alienar as pessoas que mantêm a receita de assinatura fluindo. Esse não é um equilíbrio fácil, especialmente quando cada ajuste nos mostradores de personalidade pode desencadear milhares de postagens irritadas de usuários que sentem que algo que amavam foi retirado. É como tentar redesenhar seu gato para um cachorro. Boa sorte com isso. 🐱🐶

Por enquanto, o GPT-4O está de volta, o GPT-5 está sendo remendado e o ciclo de hype da IA rola. Mas este é um tiro de aviso para o OpenAI e qualquer outra empresa de IA: na era dos algoritmos antropomorfizados, você não é apenas o código de envio-você está gerenciando uma base de fãs. E os fãs podem se transformar em críticos durante a noite. 🌟🎭

Altman tem preocupações, mas é positivo sobre o futuro da IA, fonte: x

Aqui está o resto do mini ensaio de Sam Altman. Vale a pena ler –

As pessoas usaram a tecnologia, incluindo IA de maneiras autodestrutivas; Se um usuário estiver em um estado mentalmente frágil e propenso a ilusão, não queremos que a IA reforce isso. A maioria dos usuários pode manter uma linha clara entre realidade e ficção ou dramatização, mas uma pequena porcentagem não pode. Valorizamos a liberdade do usuário como um princípio central, mas também nos sentimos responsáveis em como introduzimos novas tecnologias com novos riscos.

Incentivar a ilusão em um usuário que está tendo problemas para dizer a diferença entre realidade e ficção é um caso extremo e é bastante claro o que fazer, mas as preocupações que me preocupam mais são mais sutis. Haverá muitos casos de borda e, geralmente, planejamos seguir o princípio de “tratar usuários adultos como adultos”, que em alguns casos incluirão recuar os usuários para garantir que eles estão conseguindo o que realmente desejam.

Muitas pessoas usam efetivamente o ChatGPT como uma espécie de terapeuta ou treinador de vida, mesmo que não o descrevam dessa maneira. Isso pode ser muito bom! Muitas pessoas já estão obtendo valor com isso hoje.

Se as pessoas estão recebendo bons conselhos, subindo de nível em direção a seus próprios objetivos, e sua satisfação com a vida está aumentando ao longo dos anos, teremos orgulho de fazer algo genuinamente útil, mesmo que use e confie muito no Chatgpt. Se, por outro lado, os usuários tiverem um relacionamento com o ChatGPT, onde acham que se sentem melhor depois de falar, mas, sem saber, se afastarem de seu bem-estar a longo prazo (no entanto, eles o definirem), isso é ruim. Também é ruim, por exemplo, se um usuário deseja usar menos o ChatGPT e parece que não pode.

Eu posso imaginar um futuro em que muitas pessoas realmente confiam nos conselhos do ChatGPT para suas decisões mais importantes. Embora isso possa ser ótimo, isso me deixa desconfortável. Mas espero que esteja chegando até certo ponto, e logo bilhões de pessoas possam estar conversando com uma IA dessa maneira. Então, nós (nós como na sociedade, mas também como no Openai) precisamos descobrir como torná -lo um grande líquido positivo.

Existem várias razões pelas quais acho que temos uma boa chance de acertar isso. Temos tecnologia muito melhor para nos ajudar a medir como estamos indo do que as gerações anteriores de tecnologia. Por exemplo, nosso produto pode conversar com os usuários para entender como estão se saindo com seus objetivos de curto e longo prazo, podemos explicar problemas sofisticados e sutis aos nossos modelos e muito mais.

- OKB PREVISÃO. OKB criptomoeda

- EUR USD PREVISÃO

- A triste ironia da riqueza moderna: uma reflexão de Dostoiévskiana sobre Bitcoin

- Fartcoin em um local de incômodo

- Bitcoin a US $ 118 mil? É isso que sua carteira criptográfica precisa saber!

- IP PREVISÃO. IP criptomoeda

- “Ainda sou rico?”: Meu caso de amor muito volátil com XRP (e pânico induzido por gráficos!)

- Atualização do EVM do Filecoin: do armazenamento ao super -herói financeiro

- Dores de cabeça econômicos de Powell! 🤯

- O ETF Ethereum de Blackrock é bilhões de devoradores – eShs Shoots for the Moon!

2025-08-12 02:20